OmniTalker

7352

0

0

0

OmniTalker是阿里通义实验室开发的一款基于深度学习和多模态融合技术的新型数字人视频生成大模型。它能够通过上传一段参考视频,实现对视频中人物的表情、声音和说话风格的精准模仿,从而生成高度逼真的数字人视频。

工具标签:

直达网站

工具介绍

OmniTalker是什么?

OmniTalker是阿里通义实验室开发的一款基于深度学习和多模态融合技术的新型数字人视频生成大模型。它能够通过上传一段参考视频,实现对视频中人物的表情、声音和说话风格的精准模仿,从而生成高度逼真的数字人视频。

主要亮点

- 精准模仿能力:OmniTalker能够捕捉到参考视频中人物的细微表情和声音特点,生成与之高度相似的音视频内容,让人难以分辨真假。

- 降低成本:相较于传统的数字人制作流程,OmniTalker显著降低了制作成本,使得更多用户能够轻松拥有高质量的数字人服务。

- 增强真实感与互动体验:生成的音视频内容真实感极强,且由于能够精准模仿人物的声音和说话风格,为用户提供了更加自然、流畅的互动体验。

模型优势

- 多模态融合:OmniTalker实现了音频、视频和文本的多模态融合,使得生成的数字人更加生动、立体。

- 高效处理:模型采用先进的算法和架构,能够高效处理大量数据,快速生成高质量的音视频内容。

- 零样本学习:OmniTalker具备零样本学习能力,只需一段参考视频即可生成新的数字人视频,无需额外训练数据。

需求人群

- 内容创作者:如视频博主、主播等,可以利用OmniTalker快速生成高质量的数字人视频内容。

- 企业用户:企业可以利用OmniTalker制作虚拟客服、虚拟代言人等数字人形象,提升品牌形象和用户体验。

- 教育机构:教育机构可以利用OmniTalker制作虚拟教师、虚拟助教等数字人形象,为学生提供更加生动、有趣的学习体验。

适用场景

- 虚拟主播:利用OmniTalker生成虚拟主播形象,进行直播、录播等节目制作。

- 虚拟客服:企业可以利用OmniTalker制作虚拟客服形象,为用户提供24小时不间断的在线服务。

- 游戏与娱乐:在游戏和娱乐领域,OmniTalker可以生成虚拟角色形象,为玩家提供更加沉浸式的游戏体验。

使用便捷性

OmniTalker的使用非常简便。用户只需在平台上上传一段参考视频,选择相应的模板和参数设置,即可快速生成与之同步的音频和视频内容。目前,该项目已在魔搭社区和HuggingFace等平台开放体验,并提供了详细的教程和示例视频供用户参考。

OmniTalker如何使用

- 注册与登录:用户需要访问OmniTalker的官方网站或相关平台(如魔搭社区、HuggingFace等)进行注册和登录。

- 上传参考视频:在平台上上传一段清晰的参考视频,确保视频中的人物表情、声音和说话风格清晰可辨。

- 选择模板与参数:根据需求选择合适的模板和参数设置,如视频分辨率、帧率、音频质量等。

- 生成与导出:点击生成按钮,等待模型处理完成后即可导出生成的音视频内容。

技术背景与突破

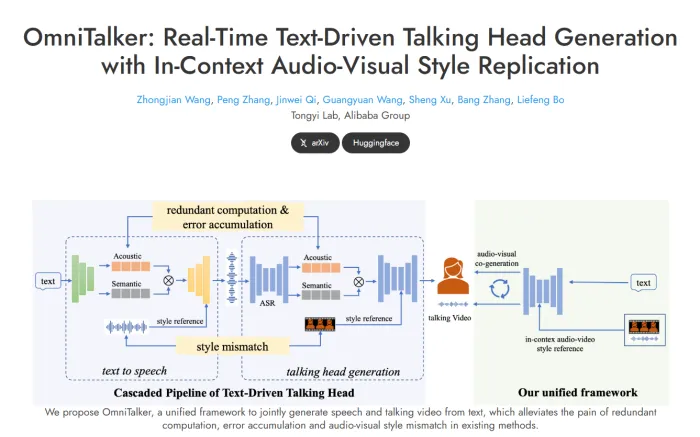

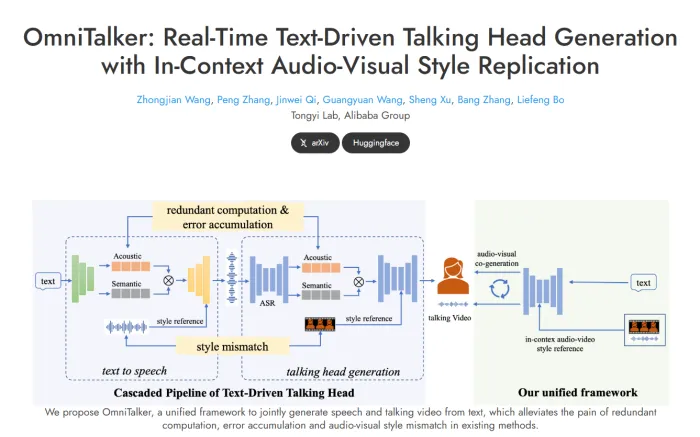

近年来,随着语言大模型和生成式AI的迅猛发展,虚拟主播和虚拟助手的应用越来越广泛。然而,传统的文本驱动数字人生成研究相对较少,且存在音画不同步、说话风格不一致等问题。OmniTalker通过引入双分支DiT架构和多模态特征融合技术,成功克服了这些技术瓶颈,实现了从文本和参考视频中同时生成同步的语音和视频。

模型结构与创新

OmniTalker的模型结构由三大核心部分构成:

- 特征提取模块:负责提取音频特征和视觉特征,并确保两者在时间上的完美同步。

- 多模态特征融合模块:将音频特征和视觉特征进行融合,提升音视频内容的整合效果。

- 解码器模块:经过预训练的解码器能够高效将合成的音视频特征转换为原始格式,保证输出的高质量。

此外,OmniTalker还采用了先进的Flow Matching训练技巧和优化算法,进一步提升了模型的性能和生成效果。

实验数据与表现

通过实验数据的对比和分析,OmniTalker在音频生成和视觉效果方面都表现出色。它显示出更低的错误率、更高的声音相似度和更逼真的视觉效果。特别是在零样本条件下,OmniTalker依然能够保持出色的生成效果,进一步证明了其强大的泛化能力和实用性。

未来发展

总的来说,阿里通义实验室推出的这款OmniTalker模型无疑是数字人生成领域的一大创新。它不仅降低了制作成本、提升了生成内容的真实感和互动体验,还为用户提供了更加简便、高效的使用方式。随着技术的不断进步和应用场景的不断拓展,相信OmniTalker将会在更多领域得到广泛应用,并为用户带来更加丰富的数字人体验。未来,我们期待OmniTalker能够继续引领数字人生成领域的发展潮流,为人工智能技术的进步贡献更多的力量。

评论

全部评论

暂无评论

热门推荐

相关推荐

Audio2Face

Audio2Face是英伟达推出的一款生成式AI面部动画模型,该模型通过深度学习和机器学习算法,实现了从音频输入到面部动画输出的实时转换。近日,英伟达宣布开源了这一模型,不仅提供了核心算法,还附带了软件开发工具包(SDK)和完整的训练框架,为游戏和3D应用领域的智能虚拟角色开发提供了强有力的支持。

Signature AI

Signature AI,一家领先的私有AI人工智能服务提供商,致力于帮助企业构建专注于安全、保障和知识产权增长的私有AI模型,同时确保卓越的输出质量。以下是对Signature AI的详细介绍。

Fabric 1.0

VEED Fabric 1.0是VEED.IO 推出的全球首款AI会说话视频模型,它实现了从静态图像到动态叙事的重大跨越,仅需一张图片结合语音输入,就能生成最长1分钟、具备逼真唇形同步和自然面部表情的会话视频。该模型专为“talking head”视频设计,生成速度极快,成本大幅降低,还集成多种生态

Voyager

HunyuanWorld-Voyager是腾讯混元团队于2025年9月2日正式推出全球首个支持原生3D重建的超长漫游世界模型。该模型以“空间一致性”与“长距离探索”为核心突破,在斯坦福大学李飞飞团队主导的WorldScore基准测试中以77.62分的综合成绩登顶榜首,超越谷歌Genie3等开源模型

小米MiMo-7B

MiMo-7B是小米AI实验室发布的首个专为推理(Reasoning)设计的开源大模型,该模型以7亿参数的轻量化架构,结合强化学习优化,展现了在数学、代码和通用推理任务上的卓越性能,甚至超越了多个32亿参数以上的基线模型。

子曰

2023年7月26日,网易有道正式发布国内首个教育领域垂直大模型——“子曰”。其研发旨在运用人工智能技术,解决教育场景实际问题,为学习者提供更高效、个性化的学习体验。自发布以来,“子曰”不断升级迭代,在教育大模型垂直应用领域取得众多突破。2023年11月,顺利通过双新评估,成为首批通

零一万物

零一万物是李开复成立的一家专注于AI 2.0大模型技术研发与应用的创新企业。在AI 2.0时代,大模型成为核心技术,它能够处理海量数据,具备强大的通用性和创造性,可跨领域、跨媒体、跨语言地执行各种任务。零一万物以大模型为基础,致力于打造一个开放、共享、协作的大模型平台。

文心一言

文心一言是百度推出的新一代知识增强大语言模型,属于文心大模型家族的新成员。这个模型能够与人进行对话互动、回答问题、协助创作,旨在帮助人们高效便捷地获取信息、知识和灵感。

0

0