ThinkSound

6787

0

0

0

ThinkSound是阿里巴巴通义实验室推出的全球首款音频生成模型。它采用先进的链式推理(Chain-of-Thought,CoT)技术,能够深入分析视频画面的场景、动作与情感,进而生成与之高度匹配的音效。无论是自然风声、城市喧嚣,还是角色对话与物体碰撞音,ThinkSound都能实现音画高保真同步

工具标签:

直达网站

工具介绍

ThinkSound是什么?

ThinkSound是阿里巴巴通义实验室推出的全球首款音频生成模型。它采用先进的链式推理(Chain-of-Thought,CoT)技术,能够深入分析视频画面的场景、动作与情感,进而生成与之高度匹配的音效。无论是自然风声、城市喧嚣,还是角色对话与物体碰撞音,ThinkSound都能实现音画高保真同步,效果逼真自然,堪称“专业AI音效师” 。

功能特点

1.多模态输入

支持视频、文本、音频或其组合等多种输入方式。

- 用户既可以通过详细的文字描述,让模型生成符合特定场景的音效,比如“在一个古老的城堡中,阴森的风声呼啸而过,偶尔传来水滴落下的声音”;

- 也可以直接上传一段视频片段,模型便能根据视频内容生成适配的音效;

- 甚至还能通过音频输入,让模型在已有音频基础上进行拓展或修改 。例如,上传一段节奏舒缓的音乐,要求模型添加一些鸟鸣声和流水声,营造出更加自然的氛围。

2.交互式编辑

提供交互式编辑功能,支持通过点击或语言指令对特定音效进行精细调整。创作者在生成音效后,如果觉得某个部分不太满意,比如觉得一段打斗场景中的武器碰撞声不够清脆,就可以通过点击视频中对应的画面位置,然后输入指令“让武器碰撞声更清脆响亮”,模型便会按照要求对音效进行优化 。

3.广泛的格式与分辨率支持

其算法确保音频与视频帧精准对齐,支持MP4、MOV、AVI和MKV等多种视频格式,并且兼容从标清到4K分辨率,无论创作者使用何种设备、何种画质要求进行创作,ThinkSound都能很好地满足 。

核心优势

1.多模态融合

融合了计算机视觉、自然语言处理与音频生成技术。先进的计算机视觉算法逐帧分析视频内容,理解物体交互、环境背景及人物行为,从而生成高度契合的音效与音景。

- 在自然场景中,可生成潺潺流水或鸟鸣声;

- 在都市场景中,能精确还原车辆鸣笛与人群喧闹 。

例如,当分析一段森林中的视频时,模型能识别出树木、溪流、飞鸟等元素,进而生成与之对应的风声、流水声、鸟鸣声,并且这些声音的音量、节奏、空间位置等都与视频中的画面完美匹配 。

2.高精度同步

在音画同步方面表现尤为出色。官方数据显示,ThinkSound在视频-音频生成基准测试中位居行业前列,其生成的音频与视频画面的同步精度极高,有效避免了传统音效生成中常见的音画不同步问题,为观众带来更加沉浸式的体验 。

技术原理

ThinkSound首次将思维链(CoT)技术应用于音频生成领域。通过引入结构化推理机制,模型先理解视频整体画面与场景语义,再聚焦具体声源对象,最后响应用户编辑指令,逐步生成高保真且同步的音频。

它由多模态大语言模型和统一音频生成模型组成。多模态大语言模型负责“思考”推理链,基于流匹配的统一音频生成模型负责“输出”声音 。面对一段表现厨房烹饪的视频,多模态大语言模型首先会分析视频中出现的各种元素,如炉灶上的火焰、锅里翻炒的食物、旁边水龙头流出的水等,然后根据这些元素的运动状态、相互关系等信息,推理出应该产生的声音,比如火焰的呼呼声、食物翻炒的滋滋声、水流的哗哗声等。接着,统一音频生成模型根据这些推理结果,生成对应的高保真音频 。

数据集支持

通义语音团队构建了首个支持链式推理的多模态音频数据集AudioCoT。它融合了来自VGGSound、AudioSet、AudioCaps、Freesound等多个来源的2531.8小时高质量样本,覆盖从动物鸣叫、机械运转到环境音效等多种真实场景,为模型提供了丰富而多样化的训练基础。

为确保每条数据都能真正支撑AI的结构化推理能力,研究团队设计了一套精细化的数据筛选流程,包括多阶段自动化质量过滤和不少于5%的人工抽样校验,层层把关以保障数据集的整体质量。在此基础上,AudioCoT还特别设计了面向交互式编辑的对象级和指令级样本,以满足ThinkSound在后续阶段对细化与编辑功能的需求 。

性能表现

在开源的VGGSound测试集上,ThinkSound的多项核心指标相比现有主流方法如MMAudio、V2A - Mappe、V - AURA等,均实现了15%以上的提升。在代表模型对声音事件类别和特征判别精准度的KLPaSST和KLPaNNs两项指标上,取得了同类模型中的最佳成绩。在电影复杂场景数据集MovieGenAudioBench上,ThinkSound也以20%的优势超越Meta的MovieGenAudio模型 。这充分证明了ThinkSound在音频生成质量、对声音事件的理解和处理能力等方面的卓越性能 。

应用场景

1.影视后期制作

能够快速为无声视频生成环境音效、角色对话或背景音乐,显著提升后期制作效率。在一部古装剧中,制作团队可以利用ThinkSound为一段宫殿内的场景快速添加环境音效,如微风拂过窗帘的声音、远处传来的钟声等,增强场景的真实感和氛围感 。对于一些没有现场收音条件或者需要重新配音的场景,ThinkSound也能根据画面内容生成合适的角色对话音效 。

2.游戏音效设计

游戏开发者可利用其生成动态音效,为虚拟场景增添沉浸感。在一款冒险游戏中,当玩家进入一个神秘的洞穴时,ThinkSound可以根据洞穴的环境特征,如潮湿的墙壁、滴答的水滴、狭窄的通道等,生成相应的音效,如水滴声、风声在洞穴内的回响等,让玩家更加身临其境 。而且,随着玩家在游戏中的行动和场景的变化,音效也能实时动态调整 。

3.互动媒体及教育内容创作

其语音合成技术支持多语言对话生成,结合精准的唇部同步与情感表达,为虚拟角色赋予更真实的生命力。在一个在线教育课程中,虚拟老师的讲解可以通过ThinkSound生成自然流畅的语音,并且语音的情感、语调等都能根据讲解内容进行调整 。在互动媒体中的虚拟角色,如智能客服、虚拟导游等,也能借助ThinkSound的技术,以更加生动、自然的语音与用户进行交互 。

开源情况

ThinkSound的模型权重与推理脚本已在GitHub、Hugging Face、魔搭社区等平台全面开源,开发者可以免费获取。这一举措大幅降低了AI音效生成的技术门槛,使中小型创作者、独立开发者及学术研究人员能够轻松接入专业级音效生成工具,有助于推动音频生成技术的发展和创新,促进更多基于该模型的二次开发和应用场景的拓展 。

如何使用

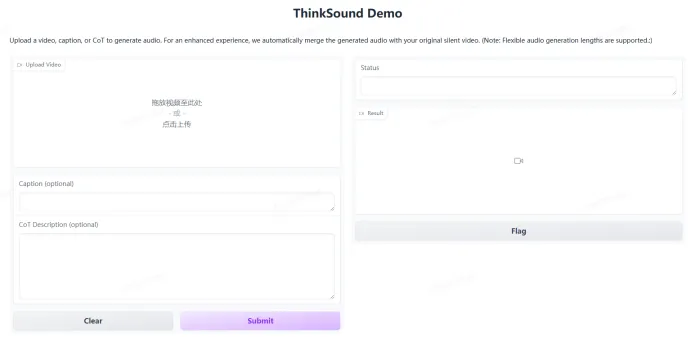

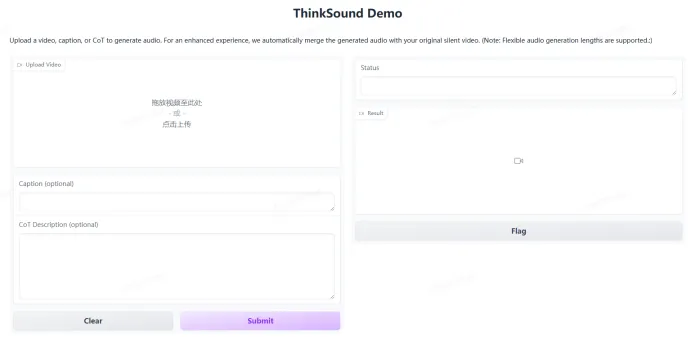

在线体验

用户可以通过访问https://www.modelscope.cn/studios/iic/ThinkSound,在网页上直接上传视频或输入文本描述,体验ThinkSound的音频生成功能。按照页面提示操作,即可快速获得生成的音效 。

开发者接入

对于开发者而言,如果想要在自己的项目中集成ThinkSound,可以从上述开源平台获取模型权重与推理脚本。根据官方提供的文档和教程,将模型接入到自己的开发环境中,然后通过编写代码来调用模型的功能,实现根据视频、文本等生成音频的操作 。例如,在Python环境中,利用相应的库和接口,按照文档说明的参数设置和调用方式,就可以实现对ThinkSound模型的调用 。

想了解AITOP100平台其它版块的内容,请点击下方超链接查看

AI创作大赛 | AI活动 | AI工具集 | AI资讯专区

AITOP100平台官方交流社群二维码:

评论

全部评论

暂无评论

热门推荐

相关推荐

Quasar Alpha

Quasar Alpha是一款近期神秘亮相的全新AI模型,由一家未具名的模型实验室推出,被称为其首款“隐秘”模型,是即将发布的长上下文基础模型的预发布版本。它凭借超长的上下文处理能力、优化的编码能力,以及免费开放策略,迅速成为业界热议焦点,为AI技术发展增添了新期待。

AudioStory

AudioStory模型是腾讯ARC实验室推出的一款开源音频模型,该模型用大语言模型生成长音频,通过创新的“分而治之”策略与双通道解耦机制,解决了长音频生成中的逻辑与情感断层问题,实现了电影级音频的智能生成与续写,并正以开源策略推动AI音频叙事领域的技术革新。

Seele AI

Seele AI是由全灵(深圳)人工智能有限公司推出的全球首个端到端AI生成3D游戏的多模态大模型,它以自然语言为驱动,支持文本、语音、图片、视频等多模态输入,可一键生成包含角色、场景、玩法逻辑、物理规则、动画音效等全要素的完整3D游戏世界,实现“零代码”创作与动态迭代优化。

K2 Think

K2 Think是阿联酋穆罕默德·本·扎耶德人工智能大学与科技集团G42联合推出的开源大语言模型(LLM),以320亿参数的紧凑架构实现性能跃迁,在数学、科学等复杂推理任务中超越参数规模大20倍的旗舰模型,重新定义了高效推理的技术边界,自称为全球最快的开源AI模型和最先进的开源AI推理系统

HiDream-I1

HiDream-I1是由千象HiDream ai(智象未来)团队打造的国产开源图像生成模型。它基于扩散模型技术,拥有17亿参数,这一规模在开源模型中颇具竞争力,能够依据文本描述生成高质量图像,为众多领域带来了全新的图像创作解决方案。

Nes2Net

Nes2Net是专为语音防伪检测量身打造的深度学习模型架构,它直接处理高维特征以避免信息损失,通过独特的嵌套结构实现多层次、多粒度的特征交互,具备无降维处理、多尺度特征提取、轻量化设计以及强鲁棒性与泛化能力等特点,能有效识别多种伪造声音类型,在提升检测精度的同时降低计算成本。

GAIA-2

GAIA-2是Wayve公司最新推出的一款专为辅助驾驶和自动驾驶设计的视频生成世界模型。它利用先进的生成式人工智能技术,能够模拟出各种复杂的驾驶场景,为自动驾驶系统的训练和验证提供丰富、多样的数据支持。

文心一言

文心一言是百度推出的新一代知识增强大语言模型,属于文心大模型家族的新成员。这个模型能够与人进行对话互动、回答问题、协助创作,旨在帮助人们高效便捷地获取信息、知识和灵感。

0

0