EasyControl

6557

0

0

0

EasyControl是一个在人工智能绘画领域具有创新意义的框架,专为基于 Transformer 架构的扩散模型(DiT)设计,旨在提供高效且灵活的条件控制能力,犹如为DiT模型装上了强大的“ControlNet

工具标签:

直达网站

工具介绍

EasyControl:为DiT模型插上“ControlNet”的翅膀

在人工智能绘画领域,扩散模型(Diffusion Model)正经历着从基于Unet架构向基于Transformer架构(DiT)的深刻转变。然而,DiT生态系统在插件支持、效率以及多条件控制等方面仍面临诸多挑战。为了应对这些挑战,由Xiaojiu-z领衔的团队推出了名为EasyControl的创新框架,旨在为DiT模型提供高效且灵活的条件控制能力,犹如为DiT模型装上了强大的“ControlNet”。

EasyControl是什么?

EasyControl 是一款先进的框架,专为优化Diffusion Transformer(扩散变换器)的控制而设计。它致力于克服DiT生态系统中面临的效率制约和模型适应性问题。该框架的核心优势在于其能够支持多样化的条件组合,显著增强了图像生成的灵活性和推理速度。基于最新的研究进展,EasyControl 成为了图像生成和风格转换等领域内的理想选择。

EasyControl的核心优势

EasyControl并非简单的模型叠加,而是一套经过精心设计的统一条件DiT框架。其核心优势在于通过引入一系列创新技术,实现了显著的性能提升。

- 轻量级条件注入LoRA模块:这一模块允许条件信号的独立注入,避免了对基础模型权重的修改,从而支持了灵活的条件注入和多条件泛化。

- 位置感知训练范式:通过标准化输入条件以固定分辨率,实现了任意宽高比和灵活分辨率的图像生成,同时优化了计算效率。

- 因果注意力机制与KV缓存技术:这一创新显著降低了图像合成的延迟,提高了框架的整体效率。

这些创新设计使得EasyControl在模型兼容性(即插即用,风格无损控制)、生成灵活性(支持多种分辨率、宽高比和多条件组合)以及推理效率方面都表现出色。

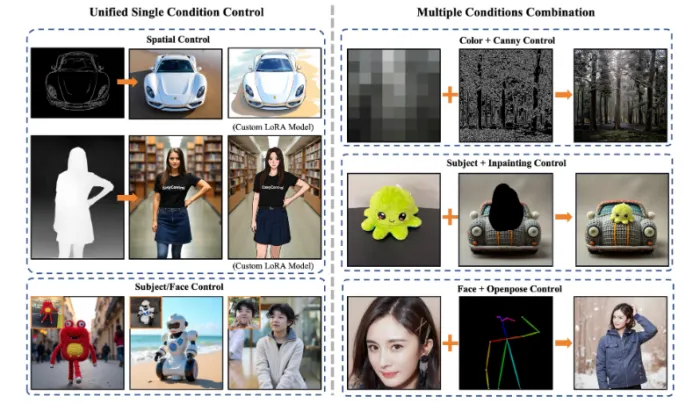

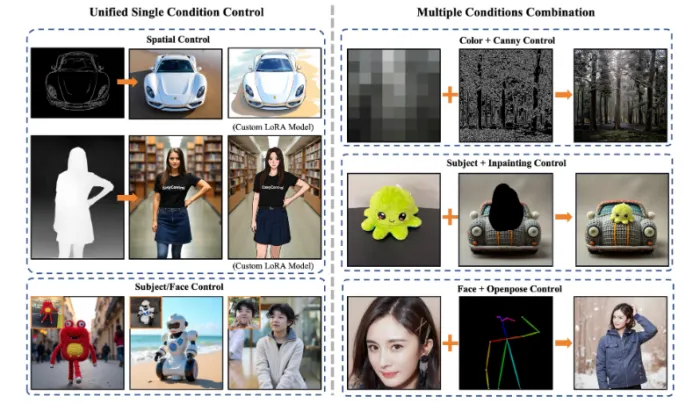

强大的多条件控制能力

EasyControl最引人注目的特性之一是其强大的多条件控制能力。它支持多种控制模型,包括但不限于:

- Canny边缘检测:用户可以指定生成物体的轮廓。

- 深度信息:用于生成具有深度感的图像。

- HED边缘草图:提供更精细的边缘控制。

- 图像修复(Inpainting):用于修复或编辑图像中的特定区域。

- 人体姿态(Pose):可以类比OpenPose,引导生成具有特定人物动作的图像。

- 语义分割(Seg):用于生成具有特定语义结构的图像。

这意味着用户可以通过输入不同的控制信号,精确地引导DiT模型生成符合特定结构、形状和布局的图像。这种细致的控制能力极大地拓展了DiT模型的应用场景。

令人惊艳的吉卜力画风转换

除了基础的结构控制,EasyControl还展现了强大的风格迁移能力,尤其是在吉卜力画风转换方面。研究团队利用仅100张真实亚洲人脸和GPT-4o生成的吉卜力风格对应图像进行训练,开发出专门的LoRA模型。该模型在将人像转化为经典吉卜力动画风格的同时,还能很好地保留原始面部特征。

用户只需上传人像照片,并配合相应的提示词,即可轻松生成具有浓郁手绘动漫风格的艺术作品。项目方还提供了Gradio演示,方便用户在线体验这一功能。这一特性无疑为动漫爱好者、设计师等提供了极大的创作便利。

EasyControl用户群体:

"本产品专为研究人员、开发者和图像生成领域的专业人士设计,尤其适用于那些追求高效图像生成及风格转换的用户。其卓越的灵活性和高效性能助力用户轻松实现创意构想和艺术表现。"

EasyControl应用场景:

- 通过 EasyControl,用户可快速生成高清图像,并轻松实现多样化的艺术风格转换。

- 利用 Ghibli 风格模型,轻松打造具有独特艺术气息的肖像画作。

- 在图像合成过程中,结合空间与主题条件,轻松构建复杂场景的图像。

EasyControl操作指南:

新建并激活 conda 环境。

安装必要的依赖库。

从 Hugging Face 平台下载所需的模型文件。

初始化模型,并加载控制参数。

根据预设条件,生成目标图像。

EasyControl未来发展

EasyControl项目团队目前已经发布了推理代码和预训练权重,为研究人员和开发者提供了初步的工具支持。根据其Todo List,未来还将推出空间预训练权重、主体预训练权重以及训练代码,这将进一步完善EasyControl的功能,并满足更多应用场景的需求。

EasyControl的出现无疑为基于Transformer的扩散模型注入了强大的控制能力,有效地弥补了DiT模型在条件控制方面的不足。其对多种控制模式的支持,以及令人印象深刻的吉卜力画风转换能力,都预示着其在AI内容生成领域拥有广阔的应用前景。凭借其高效、灵活和易用的特点,EasyControl有望成为DiT模型生态中一个重要的组成部分,推动人工智能绘画领域向更高层次发展。

评论

全部评论

暂无评论

热门推荐

相关推荐

MiniGPT-4

MiniGPT-4是一个融合了视觉编码器和高级大型语言模型(LLM)Vicuna的创新模型,二者通过一个投影层实现协同工作。该模型展现了与GPT-4相媲美的功能,例如能够生成详尽的图像描述,以及从手绘草图创建网站。

面壁露卡

「面壁露卡 Luca」是面壁智能基于自研千亿参数基座模型 CPM 打造的多模态智能对话助手。

朱雀大模型检测

验室上线的这款AI生成图片与文章鉴别工具-朱雀大模型检测,是一款基于深度学习和自然语言处理技术的智能检测平台。它通过对上传的图片和文章进行深度分析,捕捉真实与AI生成内容之间的差异,从而实现对AI生成内容的准确鉴别

Chirp 3

高清语音模型 Chirp 3 是谷歌云推出的一款先进语音合成工具,支持 248 种不同声音和 31 种语言,能够捕捉人类语调的细微差别,生成生动自然的语音,并通过 Vertex AI 平台向开发者开放,助力程序创新。

魔多

魔多AI社区是厚德云旗下一个专为AI创作者打造的趣玩社区,集算力GPU云服务器、模型与镜像分享、在线工作流、在线模型训练、算力激励等为一体的AI创作生态社区

模力指数GEO

模力指数GEO是一款面向大模型时代的品牌监测产品,通过持续分析主流AI模型中的数据,从提及度、认知准确度、推荐度、情感倾向和竞争对比五个维度,量化品牌在生成式AI环境中的认知表现。该产品提供定制看板、趋势洞察与竞品分析,帮助企业发现AI语境下的认知盲区与风险,为品牌优化提供数据支持.

Marble

Marble是由斯坦福大学教授、"AI教母"李飞飞创立的World Labs推出的全球首款商用多模态世界模型。作为生成式AI领域的革命性产品,Marble突破了传统3D建模的技术边界,通过文本、图像、视频甚至3D草图等多种输入方式,可实时生成具备物理规则的持久性3D环境。

Gitee AI(模力方舟)

Gitee AI(模力方舟)是开源中国针对中国市场和用户需求,推出的一站式AI大模型托管平台。它致力于构建一个活跃的开发者社区,为开发者提供从模型托管、训练、部署到应用落地的全方位服务。通过汇聚最新的AI模型、数据集和应用场景,旨在帮助开发者和企业更高效地实现AI技术的落地和应用。

0

0