AniSora

9467

0

0

0

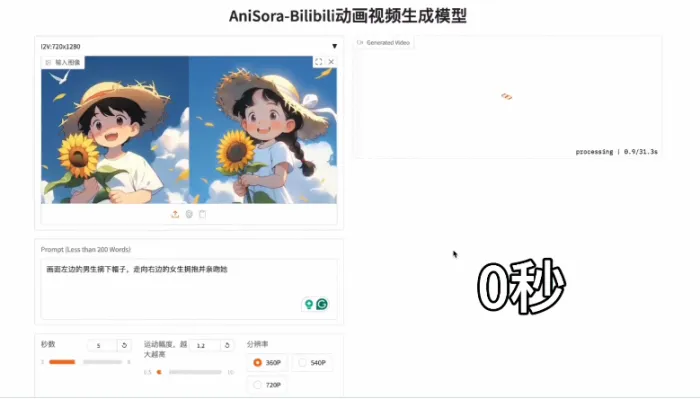

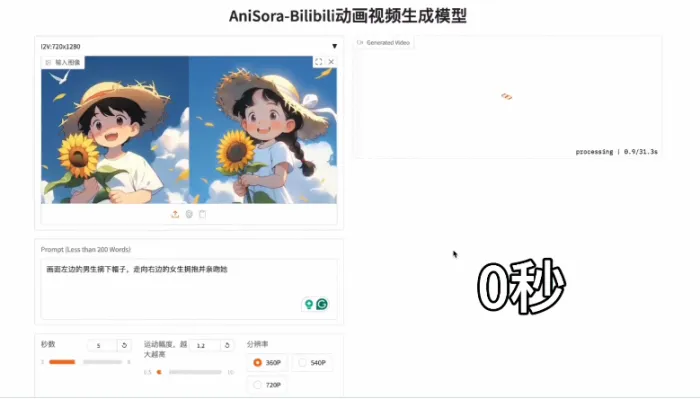

Bilibili(B站)的开源动漫视频生成模型AniSora是专为动漫视频生成设计的综合系统,该模型具备海量数据支持、时空掩码技术、专业评估体系三大核心优势,可一键生成多种动漫风格的视频内容,显著降低创作门槛并提升制作效率。

工具标签:

直达网站

工具介绍

一、AniSora是什么?

AniSora是B站团队基于IJCAI 2025接收的论文成果开发的开源动漫视频生成系统,其技术定位可概括为:

- 专为二次元内容优化:针对动漫独特的艺术风格(如日漫、国漫、美漫)、夸张动作(如超高速移动、非物理变形)及多样化场景(番剧、VTuber表演、鬼畜动画)设计,突破传统模型在动漫生成中的局限性。

- 全链路可控生成:通过时空掩码模块实现图像到视频、帧插值、局部区域引导等核心功能,支持从单张图片生成连贯动画,或对已有视频进行精准编辑。

- 开源生态构建:提供完整训练代码、预训练模型及评估基准,支持在RTX 4090等消费级硬件上部署,降低技术门槛,促进社区协作。

二、核心能力:

1. 千万级数据处理流水线

- 数据规模:整合超过1000万条高质量文本-视频配对数据,覆盖中、日、美三大动画流派,涵盖番剧、国创、漫画改编、VTuber内容等30余个场景。

- 数据预处理:通过视频时空特征提取、字幕与水印移除等技术,确保数据质量,避免生成伪影(如乱码字幕)。

2. 时空掩码可控生成模型

- 图生视频(Image-to-Video):上传单张图片即可生成连贯动态视频,支持自定义角色动作、镜头运动(如缩放、旋转)。

- 帧插值(Frame Interpolation):在关键帧间智能插入中间帧,实现平滑过渡,支持首尾帧引导、多帧插值等模式,减少手工绘制工作量。

- 局部图像引导(Localized Motion Control):通过遮罩技术精准控制特定区域(如角色面部、肢体)的运动,结合前景检测与目标跟踪,实现复杂动作编辑。

- 技术框架:基于Masked Diffusion Transformer,采用3D Causal VAE编码时空特征,结合3D-RoPE(三维相对位置编码)与全局注意力机制,提升动态一致性与细节保真度。

3. 强化学习优化与评估体系

- AnimeReward系统:构建高质量奖励数据集,通过人类偏好对齐(RLHF)优化生成内容的自然度与观感。

- 评估基准:发布包含948段动画视频的评测数据集,通过双盲人评实验与VBench测试,在人物一致性、运动流畅性等维度达到SOTA(行业领先水平)。

三、需求人群:

- 动画工作室与独立创作者:快速生成高质量动画片段,降低制作成本(如传统手绘需数周完成的分镜,AniSora可实时生成)。

- 虚拟主播(VTuber)运营团队:生成舞蹈、表演等动态视频,丰富直播内容,提升观众互动。

- 漫画IP孵化方:将静态漫画快速转化为动画,拓展IP价值(如《一人之下》等国漫IP可通过AniSora生成PV宣传片)。

- 教育机构与学习者:作为教学工具,帮助学生掌握动画制作技巧(如通过局部引导功能理解运动规律)。

- 营销与娱乐内容团队:生成动画广告、社交媒体短视频,提升传播效果(如品牌方可快速制作二次元风格产品宣传片)。

四、应用场景:

1. 动画制作

- 案例:某小型动画工作室使用AniSora生成番剧《灵笼》的战斗场景,通过图生视频功能将概念图转化为动态视频,结合帧插值优化动作流畅性,制作周期缩短60%。

- 优势:支持多风格生成(如2D手绘、3D建模),适配不同项目需求。

2. VTuber内容创作

- 案例:虚拟主播“琉绮Ruki”利用AniSora生成舞蹈表演视频,通过局部引导功能精准控制角色肢体动作,实现与观众实时互动。

- 优势:降低内容制作门槛,提升直播吸引力。

3. 漫画改编与IP孵化

- 案例:快看漫画使用AniSora将《偷偷藏不住》改编为动态漫画,通过帧插值技术优化角色对话场景,用户留存率提升35%。

- 优势:快速验证IP市场潜力,降低试错成本。

4. 教育与培训

- 案例:中国传媒大学动画学院将AniSora引入教学,学生通过局部引导功能实践“角色口型同步”技术,学习效率提升50%。

- 优势:提供低成本、高效率的实践工具。

5. 营销与娱乐

- 案例:某品牌通过AniSora生成二次元风格产品广告,结合强化学习优化视觉风格,用户点击率提升40%。

- 优势:满足年轻用户对个性化内容的需求。

五、如何使用AniSora?

1. 本地部署(以AniSora V1.0为例)

硬件要求:4张RTX 4090显卡(或等效算力设备)。

步骤:

- 创建虚拟环境:使用Miniconda安装Python 3.10,并激活环境。

- 克隆仓库:从GitHub下载项目代码(

git clone https://github.com/bilibili/Index-anisora.git)。 - 安装依赖:修改

requirements.txt中的pyav为av,并执行pip install -r requirements.txt。 - 下载模型:从HuggingFace或ModelScope下载预训练权重(如

CogVideoX_VAE_T5、5B模型权重),并放置于指定目录。 - 模型推理:运行

python demo.py --base configs/cogvideox/cogvideox_5b_720_169_2.yaml生成视频。

2. 开发接口与插件扩展

- API支持:提供RESTful API,开发者可通过HTTP请求调用模型生成视频。

- 插件生态:支持自定义插件开发(如连接企业微信、数据库查询),扩展应用场景。

六、行业影响:

1. 技术普惠:降低创作门槛

- 零代码开发:业务人员可通过自然语言描述快速生成视频,无需专业编程技能。

- 硬件适配:与昆仑芯合作推出“文心一体机”,推理延迟降至10毫秒,支持本地化部署,满足金融、政务等高安全需求场景。

2. 生态闭环:从开发到变现的全链路支持

- 流量分发:智能体可一键部署至B站搜索、文心一言App、小度音箱等10余个渠道,日均触达用户超5亿。

- 商业变现:提供订阅制、按需付费等模式,某教育机构通过付费问答功能实现月收入超20万元。

3. 全球化布局:推动中国AI标准输出

- 多语言支持:平台已支持中英文双语开发,并与IBM、蓝美视讯等国际企业合作,在东南亚、欧洲市场落地“存储+AI”解决方案。

- 开源协作:通过GitHub等平台吸引全球开发者贡献代码,加速技术迭代。

AniSora,开启AI动漫普惠新时代

AniSora的开源不仅是B站在AI领域的技术突破,更是对动漫创作生态的重构。从降低制作门槛的零代码工具,到覆盖全场景的智能体解决方案,AniSora正在让每个个体都能参与到AI创新中。

未来,随着多模态感知、MCP协议等技术的成熟,智能体将进一步跨越“可用”与“好用”的门槛,成为连接物理世界与数字世界的核心纽带。AniSora,正以开放、协同的姿态,携手全球开发者共同迈向AGI(通用人工智能)的星辰大海。

想了解AITOP100平台其它版块的内容,请点击下方超链接查看

AI创作大赛 | AI活动 | AI工具集 | AI资讯专区

AITOP100平台官方交流社群二维码:

评论

全部评论

暂无评论

热门推荐

相关推荐

OmniTalker

OmniTalker是阿里通义实验室开发的一款基于深度学习和多模态融合技术的新型数字人视频生成大模型。它能够通过上传一段参考视频,实现对视频中人物的表情、声音和说话风格的精准模仿,从而生成高度逼真的数字人视频。

文心一言

文心一言是百度推出的新一代知识增强大语言模型,属于文心大模型家族的新成员。这个模型能够与人进行对话互动、回答问题、协助创作,旨在帮助人们高效便捷地获取信息、知识和灵感。

AniSora

Bilibili(B站)的开源动漫视频生成模型AniSora是专为动漫视频生成设计的综合系统,该模型具备海量数据支持、时空掩码技术、专业评估体系三大核心优势,可一键生成多种动漫风格的视频内容,显著降低创作门槛并提升制作效率。

方糖大模型

方糖大模型是像素蛋糕自主研发的AI影像生成与处理系统,专为商业摄影、广告营销、影视制作、游戏开发等场景设计。其核心优势在于通过百亿级参数规模与多尺度分层蒸馏技术,实现高效、高质量的图像生成与编辑,同时符合国家政策对安全性和规范性的严格要求。

DeepSeek

DeepSeek是由幻方量化于2023年4月创立的一家AI公司,专注于开发高性能的大语言模型。DeepSeek的DeepSeekChat已经通过了北京市生成式人工智能服务备案,并计划向公众开放服务。

模力指数GEO

模力指数GEO是一款面向大模型时代的品牌监测产品,通过持续分析主流AI模型中的数据,从提及度、认知准确度、推荐度、情感倾向和竞争对比五个维度,量化品牌在生成式AI环境中的认知表现。该产品提供定制看板、趋势洞察与竞品分析,帮助企业发现AI语境下的认知盲区与风险,为品牌优化提供数据支持.

Qwen Chat

Qwen Chat是阿里通义千问团队推出的一个集成多种Qwen AI大模型的Web UI界面,它为用户提供了一个强大且高效的AI交互平台。该平台基于先进的AI技术,集成了多种Qwen AI大模型,旨在为用户提供丰富多样的功能,以满足不同场景下的需求。

讯飞星辰Maas平台

讯飞星辰作为科大讯飞倾力打造的AI大模型定制训练平台,致力于为用户打造独一无二的专属大模型。该平台汇聚了超过20个在行业内广受认可的优质模型,诸如星火大模型、Llama3等,均在其列。更为便捷的是,讯飞星辰支持零代码微调功能,极大地降低了大模型精调的复杂性和门槛。

0

0