工具描述

Parakeet-TDT-0.6B-V2是英伟达在语音识别技术领域的又一力作,它基于先进的FastConformer架构,并融合了创新的TDT解码器,是一款专注于英文自动语音识别的强大模型。作为Parakeet模型的升级版本,它不仅继承了前代模型的优秀基因,还在性能和功能上实现了重大突破。

工具介绍

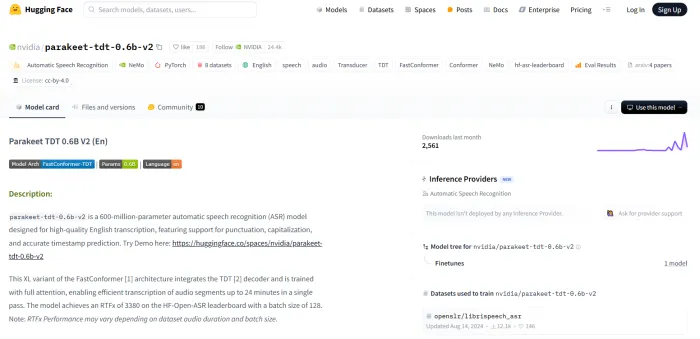

Parakeet-TDT-0.6B-V2是什么?

Parakeet-TDT-0.6B-V2是英伟达在语音识别技术领域的又一力作,它基于先进的FastConformer架构,并融合了创新的TDT解码器,是一款专注于英文自动语音识别的强大模型。作为Parakeet模型的升级版本,它不仅继承了前代模型的优秀基因,还在性能和功能上实现了重大突破。

主要功能

- 自动加标点和大小写:在日常的语音转文字过程中,标点和大小写的正确使用对于文本的可读性和准确性至关重要。Parakeet-TDT-0.6B-V2能够智能地识别语音中的停顿、语气等信息,自动为转录文本添加合适的标点符号,并根据语义和语法规则自动调整大小写,让生成的文字如同人工书写一般自然流畅。

- 精准预测逐字时间戳:对于需要精确同步的场景,如视频字幕制作、语音高亮显示等,逐字时间戳的准确性至关重要。该模型可以精准预测每个词出现的时间点,为每个词生成详细的时间戳,时间戳的精度甚至可以达到毫秒级别。这使得在将语音转录为文字后,能够轻松实现与音频或视频的精准同步,大大提高了工作效率和用户体验。

- 格式化内容识别:在语音中,经常会涉及到数字、金额、日期等格式化内容。Parakeet-TDT-0.6B-V2具备强大的格式化内容识别能力,能够准确识别这些特殊格式的内容,并按照正确的格式进行转录。例如,当语音中提到“2025年5月6日”时,模型能够准确识别并将其转录为正确的日期格式,避免了因格式错误而导致的信息误解。

技术参数

- 模型规模:Parakeet-TDT-0.6B-V2拥有6亿个参数,这一庞大的参数规模使得模型能够学习到更多的语音特征和语义信息,从而在识别准确性和泛化能力上表现出色。

- 实时因子(RTFx):实时因子是衡量语音识别模型速度的重要指标,它表示模型处理音频的速度与实时播放速度的比值。该模型在测试中实现了RTFx为3386的惊人成绩,这意味着它处理音频的速度是实时播放速度的3386倍,能够在极短的时间内完成长音频的转录任务。

- 词错误率(WER):词错误率是衡量语音识别模型准确性的关键指标,它表示转录文本中错误的词数与总词数的比例。Parakeet-TDT-0.6B-V2在Hugging Face的公开ASR排行榜上取得了仅6.05%的词错误率,这意味着每100个词中只有约6个出错,在当前业界处于领先水平,接近市面上多个商业转录工具的表现。

需求人群

- 开发者:对于从事语音识别相关应用开发的开发者来说,Parakeet-TDT-0.6B-V2是一个强大的工具。他们可以利用该模型快速构建各种语音识别应用,如智能语音助手、语音导航系统等,大大缩短开发周期,降低开发成本。

- 研究人员:在语音识别领域进行研究的科研人员需要不断探索新的算法和模型,以提高语音识别的性能。Parakeet-TDT-0.6B-V2的开源特性使得研究人员可以深入研究其内部机制,对其进行改进和优化,推动语音识别技术的发展。

- 行业团队:在会议记录、影视制作、在线教育等行业,语音转文字是日常工作中的重要环节。行业团队可以借助Parakeet-TDT-0.6B-V2提高语音转文字的效率和准确性,提升工作质量和竞争力。

应用场景

- 转录服务:在法律、医疗、媒体等行业,大量的音频资料需要进行转录。Parakeet-TDT-0.6B-V2能够快速、准确地将音频转录为文字,为这些行业提供高效的转录服务,节省人力和时间成本。

- 语音助手:智能语音助手已经成为人们生活中不可或缺的一部分。该模型的高准确性和快速响应能力,使得语音助手能够更好地理解用户的语音指令,提供更加精准的服务,如查询信息、控制家电等。

- 字幕生成:在影视制作和在线视频领域,字幕是提升用户体验的重要因素。Parakeet-TDT-0.6B-V2可以自动为视频生成精准的字幕,并实现与视频的精准同步,为观众带来更好的观看体验。

- 对话式AI平台:对话式AI平台需要具备强大的语音识别和理解能力,才能与用户进行流畅的交互。该模型可以为对话式AI平台提供可靠的语音识别支持,帮助平台更好地理解用户的意图,实现更加自然、智能的对话。

主要优势

- 速度优势:与其他语音识别模型相比,Parakeet-TDT-0.6B-V2的速度优势十分明显。它比其他模型快上50倍,能够在1秒内转录60分钟的音频,这一速度让它在处理大规模音频数据时具有巨大的优势,能够大大提高工作效率。

- 性能优势:该模型在保持高速转录的同时,还能保持较低的词错误率,实现了速度与准确性的完美平衡。它能够在不同的噪声环境下保持稳健的性能,适用于各种音频格式的转录,无论是清晰的人声还是带有背景噪音的语音,都能实现高质量的转录。

- 兼容性与灵活性:Parakeet-TDT-0.6B-V2针对英伟达的多款GPU硬件进行了优化,如A100、H100、T4和V100等,能够充分发挥GPU的性能优势。同时,它也支持在只有2GB RAM的系统上运行,具有良好的兼容性。开发者可以通过英伟达的NeMo工具包轻松部署该模型,支持Python和PyTorch等开发环境,既可直接使用,也可根据特定需求进行微调,具有很高的灵活性。

- 开源优势:作为一款开源模型,Parakeet-TDT-0.6B-V2鼓励社区参与,开发者可以自由地使用、修改和分发该模型,共同推动语音识别技术的发展。开源的特性也使得模型的透明度更高,用户可以更好地了解模型的原理和实现方式,增强了对模型的信任。

如何使用

第一步:安装NeMo工具包

要使用Parakeet-TDT-0.6B-V2模型,首先需要安装英伟达的NeMo工具包。可以通过pip命令进行安装,在安装前,请确保已安装Cython和PyTorch(2.0及更高版本)。安装命令如下:

pip install nemo_toolkit['asr']第二步:加载模型

安装好NeMo工具包后,就可以使用以下代码加载Parakeet-TDT-0.6B-V2模型:

import nemo.collections.asr as nemo_asrasr_model = nemo_asr.models.ASRModel.from_pretrained(model_name="nvidia/parakeet-tdt-0.6b-v2")第三步:进行语音识别

加载模型后,就可以使用该模型对音频文件进行语音识别了。以下是一个简单的示例代码:

transcript = asr_model.transcribe(["some_audio_file.wav"])其中,“some_audio_file.wav”是要识别的音频文件的路径,识别结果将存储在transcript变量中。

总结与发展

Parakeet-TDT-0.6B-V2的发布是英伟达在语音识别领域的一次重要突破,它以其强大的功能和卓越的性能,为开发者、研究人员和行业团队提供了一个高效、灵活的语音识别解决方案。无论是在速度、准确性还是兼容性方面,该模型都表现出了明显的优势,有望在会议记录、影视字幕、语音助手等多个领域引发变革。

随着技术的不断发展,我们有理由相信,Parakeet-TDT-0.6B-V2将在未来得到更广泛的应用和优化。英伟达也将继续投入研发资源,不断提升该模型的性能和功能,为语音识别技术的发展做出更大的贡献。让我们共同期待Parakeet-TDT-0.6B-V2在未来的精彩表现!

热门推荐

相关推荐

开搜AI搜索

开搜AI搜索,这款国产的AI搜索引擎平台,致力于为用户提供如同Google搜索般高效、便捷的搜索体验。它利用先进的AI技术,精准把握用户的搜索意图,快速呈现最相关、最可靠的信息,让您无需像使用soso搜索时那样翻阅多个网页。开搜AI搜索不仅优化了搜索引擎地址的直达功能,更在用户体验上下了大功夫,确保每位用户都能享受到直接、精准的搜索结果。

Hugging Face - 全球最大的人工智能社区

Hugging Face Hub(HF Hub)是一个基于网络的开发平台,允许注册成员上传和共享预训练的ML模型,下载和访问预训练模型,以及微调预训练模型

百炼:阿里云大模型服务平台

大模型服务平台百炼是阿里云精心打造的一站式大模型开发及应用构建平台。它整合了阿里云强大的云计算资源、先进的人工智能技术以及丰富的行业经验,为用户提供了从模型选择、开发、训练到应用构建、部署的全流程服务。无论是经验丰富的开发者,还是对技术不太熟悉的业务人员,都能在百炼平台上轻松开展大模型相关工作。

面壁露卡

「面壁露卡 Luca」是面壁智能基于自研千亿参数基座模型 CPM 打造的多模态智能对话助手。

Magma AI:微软多模态AI大模型

Magma是一款由微软精心打造的多模态AI模型,它旨在处理和整合图像、文本和视频等多种数据类型。与传统的AI系统不同,Magma不仅仅专注于视觉-语言理解或机器人操作等单一领域,而是将这两种能力结合成一个统一的模型,使得AI代理能够在数字和物理环境中执行更为复杂的任务。

DeepSeek Janus-Pro:DeepSeek文生图AI大模型

DeepSeek Janus-Pro是由中国人工智能初创公司DeepSeek于2025年1月28日发布的开源多模态AI模型。该模型主要应用于文本生成图像(文生图)领域,通过先进的算法和丰富的训练数据,实现了高质量的图像生成和多模态理解。

Signature AI:私有AI服务提供商

Signature AI,一家领先的私有AI人工智能服务提供商,致力于帮助企业构建专注于安全、保障和知识产权增长的私有AI模型,同时确保卓越的输出质量。以下是对Signature AI的详细介绍。

EmaFusion:Ema公司新一代AI语言模型

EmaFusion是Ema公司推出的一款新型AI语言模型,它采用了一种创新的“级联”判断系统,能够动态平衡成本和准确性。与传统的单一策略系统相比,EmaFusion更像是一个“任务智能大脑”,能够智能地拆解复杂的问题,并将其分配给最合适的AI模型来解决。