Gemma

5442

1

1

1

Gemma是谷歌最新开源的多模态大模型,主打低成本高性能。该模型共有1B(10亿)、4B(40亿)、12B(120亿)和27B(270亿)四种参数规模,即便最大的27B参数模型,也只需要一张Nvidia H100显卡就能高效推理。相比同类模型,Gemma-3在达到相同效果时,算力需求降低了10倍

工具标签:

直达网站

工具介绍

一、Gemma-3介绍

Gemma-3是谷歌最新开源的多模态大模型,主打低成本高性能。该模型共有1B(10亿)、4B(40亿)、12B(120亿)和27B(270亿)四种参数规模,即便最大的27B参数模型,也只需要一张Nvidia H100显卡就能高效推理。相比同类模型,Gemma-3在达到相同效果时,算力需求降低了10倍,是目前最强的小参数模型之一。

二、架构与技术亮点

- 通用解码器Transformer架构:Gemma-3采用了与前两代相同的通用解码器Transformer架构,但进行了众多创新和优化。

- 局部和全局自注意力层交错架构:为了应对长上下文带来的内存爆炸难题,Gemma-3采用了局部和全局自注意力层交错的架构。每5个局部层之间插入1个全局层,局部层的跨度仅为1024个token。这种设计降低了内存占用,提升了模型处理长上下文的能力。

- 扩展上下文长度:Gemma-3将上下文长度扩展到了128K token(10亿参数模型为32K),提高了模型处理复杂任务的能力。

- 提高全局自注意力层的RoPE基础频率:从10k提升到1M,而局部层频率保持在10k,使模型在长上下文场景下能够更好地捕捉信息,提升性能。

- 多模态能力:Gemma-3能够同时处理文本和图像,集成了定制版的SigLIP视觉编码器。这是一个基于VisionTransformer的编码器,通过CLIP损失的变体进行训练,提升了模型的多模态处理能力。

- 图像嵌入压缩技术:为了降低图像处理的推理成本,Gemma-3采用了创新的图像嵌入压缩技术。将视觉嵌入压缩为固定大小的256个向量,从而在不损失关键信息的前提下,显著减少了计算资源的消耗。

- Pan&Scan方法:允许模型灵活处理不同分辨率和宽高比的图像。通过将图像分割成多个固定大小的区域,并将这些区域调整到统一的分辨率后输入编码器,避免了因图像尺寸不一致而导致的信息丢失或变形问题。

三、高效训练过程

- 增加token预算:为适应图像和文本混合数据的训练需求,Gemma-3使用了比Gemma 2更大的token预算。27B参数的模型训练使用14T token,12B参数模型使用12T,4B参数模型使用4T,1B参数模型使用2T。

- 提升语言覆盖范围:增加了多语言数据,包括单语和并行数据,并借鉴特定策略处理语言表示不平衡的问题,以此提升模型的语言覆盖范围和多语言处理能力。Gemma-3支持140种语言,其中35种语言开箱即用。

- 使用SentencePiece分词器:Gemma-3使用与Gemini 2.0相同的SentencePiece分词器,具备分割数字、保留空格和字节级编码的特性。生成的词汇表包含262k个条目,使模型在处理非英语语言时更加平衡。

- 知识蒸馏技术:在训练优化上,Gemma-3运用知识蒸馏技术。每个token采样256个logits,按照教师概率进行加权,学生模型通过交叉熵损失来学习教师模型在这些样本中的分布。从而提升学生模型的性能。

- 后训练阶段:聚焦于提升模型的特定能力并整合新特性。采用了改进版的知识蒸馏技术,从大型指令微调教师模型中获取知识,同时结合基于改进版BOND、WARM和WARP的强化学习微调阶段。通过多种奖励函数来优化模型,旨在提升模型的帮助性、数学能力、编码能力、推理能力、指令遵循能力和多语言能力,同时最小化模型产生有害输出的可能性。

四、性能测试

谷歌在MGSM、Global-MMLU-Lite、WMT24++、RULER、MRCR等众多主流平台对Gemma-3进行了评估。结果显示,Gemma-3在多模态任务中表现出色,例如在DocVQA、InfoVQA和TextVQA等任务中,其性能显著优于前代模型。

在长文本处理方面,Gemma-3的27B模型在RULER128K上达到了66.0%的准确率,展现了强大的长文本处理能力。

在多语言支持上,Gemma-3在MGSM和Global-MMLU-Lite等任务中也取得了优异成绩。在对话能力评估中,Gemma-3的27B指令调优版本在Chatbot Arena中的Elo分数为1338,排名进入前10,接近DeepSeek-R1等大型模型。

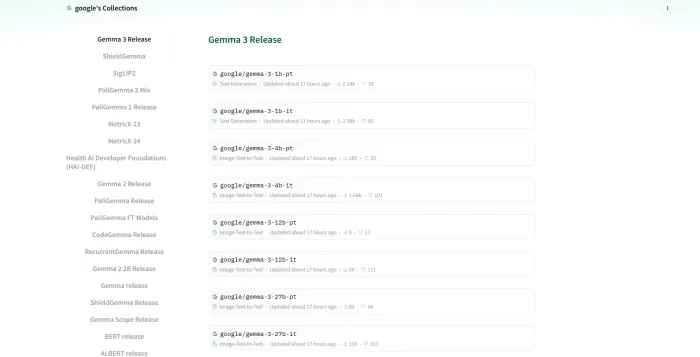

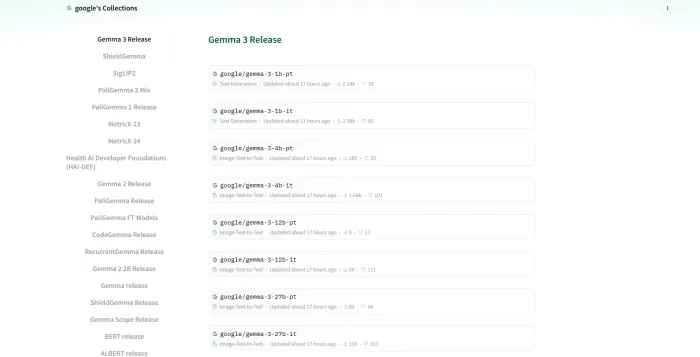

五、开源与应用

Gemma-3已经开源,开发者可以通过指定的开源地址获取模型和相关资源。该模型专为开发者设计,旨在支持他们构建能够在多种设备上运行的人工智能应用,无论是手机还是工作站,均可实现无缝运行。Gemma-3的推出,标志着谷歌在AI技术领域又迈出了重要一步,将进一步推动低成本、高性能AI模型的发展和应用。

概括起来,Gemma-3是一款具有强大性能和广泛应用前景的多模态大模型,值得开发者和AI爱好者关注和探索。

评论

全部评论

暂无评论

热门推荐

相关推荐

Chirp 3

高清语音模型 Chirp 3 是谷歌云推出的一款先进语音合成工具,支持 248 种不同声音和 31 种语言,能够捕捉人类语调的细微差别,生成生动自然的语音,并通过 Vertex AI 平台向开发者开放,助力程序创新。

美团LongCat

LongCat-Flash-Thinking模型是美团推出的一款基于混合专家架构的大型推理模型,凭借其创新的混合专家架构与动态计算机制,在逻辑推理、数学运算、代码生成及智能体任务中展现出全球领先的性能,成为开源社区中首个同时具备深度思考+工具调用与非形式化+形式化推理能力里程碑式模型。

ChatOne

ChatOne是一款由深圳市奇思妙物科技有限公司开发的AI大模型聚合平台,整合国内外主流AI模型(如GPT-4、文心一言等),提供多场景智能交互服务。其核心定位为“一站式AI生产力工具”,通过自然语言交互实现内容创作、知识管理、客服自动化等功能,旨在降低AI技术使用门槛,提升个人与企业效率。

Mistral AI

Mistral AI成立于2023年4月,总部位于法国巴黎,作为欧洲AI领域的领军企业,Mistral致力于通过开源模型与商业化服务,打破美国科技巨头的垄断,为全球开发者提供高性能、可信赖的AI解决方案。

谷歌Gemini

谷歌Gemini是一款由Google开发的多模态人工智能语言模型,它具备卓越的自然语言理解和生成能力,能够处理包括文本、图像、音频、视频和代码在内的多种信息类型。于2023年12月6日正式推出,包含了三种不同规模的模型:Gemini Ultra、Gemini Nano和Gemini Pro

子曰

2023年7月26日,网易有道正式发布国内首个教育领域垂直大模型——“子曰”。其研发旨在运用人工智能技术,解决教育场景实际问题,为学习者提供更高效、个性化的学习体验。自发布以来,“子曰”不断升级迭代,在教育大模型垂直应用领域取得众多突破。2023年11月,顺利通过双新评估,成为首批通

九章大模型MathGPT

学而思九章大模型(MathGPT)作为国内首个教育领域千亿参数大模型以及首批通过备案的教育大模型,宛如一颗璀璨新星,照亮了智慧教育前行的道路。它的诞生,不仅是技术的突破,更是教育理念与先进科技深度融合的结晶。接下来,让我们一同深入探索这一具有划时代意义的大模型。

360智脑

360智脑是360公司自主研发的认知型通用大模型,依托其在算力、数据和工程化领域的长期积累,集成360GPT大模型、360CV大模型及多模态技术能力,构建起覆盖文本、图像、语音、视频的跨模态生成体系。

1

1