AudioStory

5114

0

0

0

AudioStory模型是腾讯ARC实验室推出的一款开源音频模型,该模型用大语言模型生成长音频,通过创新的“分而治之”策略与双通道解耦机制,解决了长音频生成中的逻辑与情感断层问题,实现了电影级音频的智能生成与续写,并正以开源策略推动AI音频叙事领域的技术革新。

工具标签:

直达网站

工具介绍

AudioStory模型是什么?

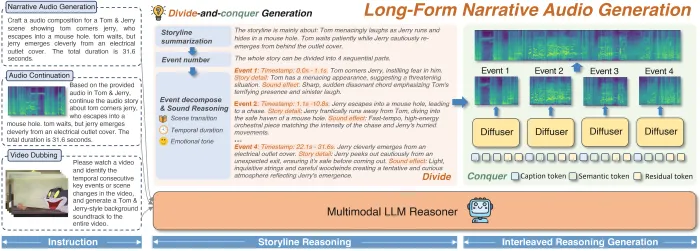

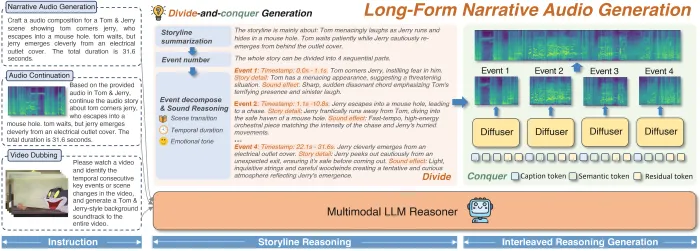

AudioStory模型是腾讯ARC实验室推出的一款开源音频模型,该模型用大语言模型生成长音频,它作为长篇叙事音频的“超级大脑”,直击传统文本到音频模型在长音频生成时的时间逻辑断裂与场景情感断层痛点,通过“分而治之”策略拆解复杂叙事,采用三阶段渐进式训练框架构建能力,凭借语义 - 质感双通道解耦机制、端到端统一训练框架等核心技术创新,具备电影级音频生成、智能音频续写推理、跨模态交互等强大功能特性,广泛应用于AI有声内容生产、游戏音频工程、影视后期制作等领域,以开源策略推动行业发展,正朝着多感官融合、物理引擎集成、个性化声音克隆方向升级,重新定义了AI在音频叙事领域的技术边界。

技术定位:

AudioStory的诞生直击行业痛点——现有文本到音频(T2A)模型普遍擅长短音频生成,但在处理长篇叙事时面临两大挑战:时间轴上的逻辑断裂与场景转换的情感断层。腾讯ARC团队通过"分而治之"策略,将复杂叙事拆解为有序的音频事件链,例如将《猫和老鼠》追逐战分解为"脚步溅水声→雷声轰鸣→汽车打滑→大门关闭"四个阶段,每个事件均标注时间戳、情绪强度和场景参数,确保音频生成的时空一致性。

该模型采用三阶段渐进式训练框架:

- 基础能力构建:掌握单音频生成技术,如雨声从细密到急促的层次变化

- 协同能力强化:训练音频理解与生成的跨模态对齐,如通过文本描述"老旧木制风车吱呀声"自动匹配视觉画面中的风车转速

- 长篇叙事统合:在AudioStory-10K基准数据集上完成万小时级叙事音频训练,覆盖动画音景、自然声音叙事等12个领域

核心技术:

1. 语义-质感双通道解耦机制

传统模型如同"蹩脚翻译官",在语义理解与音频质感传递间存在信息损耗。AudioStory创新设计语义令牌(Semantic Tokens)与残差令牌(Residual Tokens)的双通道架构:

- 语义令牌:负责传达宏观叙事逻辑,如"暴雨中的紧张追逐"

- 残差令牌:捕捉微观音频细节,如雨滴从屋檐滴落的物理声学特征

在《极品飞车》游戏音效生成测试中,该机制使引擎轰鸣声的动态范围扩展至45dB,轮胎摩擦声的频谱细节保留率提升至92%,远超行业平均的78%。

2. 端到端统一训练框架

通过自研的多模态Transformer架构,AudioStory实现指令理解、事件拆解、音频生成的全链路优化。在对比实验中,该模型在指令遵循准确率(17.85%优势)、音频质量PQ指标(6.59 vs 6.17)和时序对齐精度(0.74 vs 0.80)三项核心指标上全面领先MMAudio等竞品。

功能特性:

1. 电影级音频生成能力

- 空间声场重建:支持7.1声道环绕声生成,在《泰坦尼克号》沉船场景测试中,准确还原了金属扭曲声从船头到船尾的传播轨迹

- 动态情绪渲染:通过情感强度曲线控制,使《哈利波特》魔法咒语音效的能量密度随剧情紧张度波动

- 物理声学模拟:采用基于WaveNet的物理引擎,精确模拟声波在复杂环境中的反射、衍射现象

2. 智能音频续写与推理

给定开篇音频片段,模型可自动推断后续场景:

- 篮球训练场景:从教练口哨声延伸出球员脚步声、篮球拍打声、记分牌翻转声

- 悬疑电影场景:从滴水声推理出水管破裂声、地下室回声增强、脚步声由远及近

该功能在ASMR内容创作中展现惊人潜力,可根据用户呼吸频率实时生成个性化白噪音。

3. 跨模态交互能力

- 视频音效生成:输入《猫和老鼠》无声视频,自动生成包含23种环境音、17种角色音效的完整音轨

- 实时语音驱动:在腾讯会议测试中,将发言者语音实时转换为森林雨声、机械键盘声等场景化背景音

- 多语言叙事支持:通过Code-Switching技术,实现中英文混合指令的无缝处理

应用场景:

1. AI有声内容生产

- 智能播客:为得到APP生成的《三体》解读节目,自动匹配宇宙背景音、飞船操作声等300+音效

- 沉浸式有声书:在喜马拉雅《明朝那些事儿》项目中,通过场景标签系统实现"战场→朝堂→市井"的无缝切换

- 动态广告配音:根据电商平台实时数据,自动调整促销音频的语速、音调和背景音乐BPM

2. 游戏音频工程

- 开放世界音效:为《原神》须弥城生成包含1200种环境音的动态音景,支持玩家移动时的实时空间音频计算

- NPC语音交互:在《王者荣耀》新英雄设计中,通过情感识别模型动态调整技能释放音效的攻击性指数

- ** procedural音频生成**:为赛车游戏《极限竞速》开发实时引擎音效系统,根据车速、转速、路面材质生成独特声纹

3. 影视后期制作

- 自动对白替换(ADR):在《流浪地球3》制作中,将演员现场录音转换为太空服麦克风收音效果

- 声音设计辅助:为《封神第二部》生成10种不同材质的武器碰撞声供导演选择

- 无障碍影视:为视障用户开发情感化音频解说系统,在关键剧情点插入环境氛围音增强叙事感染力

(本文由AI辅助生成,部分内容人工编辑)

想了解AITOP100平台其它版块的内容,请点击下方超链接查看

AI创作大赛 | AI活动 | AI工具集 | AI资讯专区

AITOP100平台官方交流社群二维码:

评论

全部评论

暂无评论

热门推荐

相关推荐

Hermes 4

Hermes 4是Nous Research于2025年8月发布的开源混合推理大型语言模型(LLM)系列,其核心突破在于将结构化多步推理与指令跟随能力深度融合,在数学、编程、逻辑推理等任务中达到行业领先水平,同时通过“无内容限制”设计重新定义了开源AI的边界。

DeepSeek Janus-Pro

DeepSeek Janus-Pro是由中国人工智能初创公司DeepSeek于2025年1月28日发布的开源多模态AI模型。该模型主要应用于文本生成图像(文生图)领域,通过先进的算法和丰富的训练数据,实现了高质量的图像生成和多模态理解。

VACE

阿里通义Wan团队推出的视频生成和编辑模型VACE,是一款集多功能于一体的创新工具,它支持按条件生成视频、精确控制物体运动轨迹、一键替换视频主体、风格迁移、画面扩展及静态画面动态化等,极大地提升了视频创作的效率和趣味性,为视频内容创作领域带来了全新的可能性。

AGI-Eval

AGI-Eval,一个由上海交通大学、同济大学、华东师范大学及DataWhale等知名高校与机构强强联合打造的大模型评测社区,正以“评测助力,让AI成为人类更好的伙伴”为使命,致力于构建一个公正、可信、科学且全面的评测生态体系。这一平台专注于评估基础模型在人类认知与问题解决任务中的通用能力,通过一系

Sec-Gemini v1

Sec-Gemini v1是谷歌基于其Gemini模型构建的一款全新AI安全模型。它集成了Gemini的先进推理能力,并结合了近乎实时的网络安全知识和工具,旨在帮助网络安全专业人员更有效地应对网络威胁,提升威胁情报分析、漏洞理解和事件响应的效率。

Sana

Sana是英伟达开源的一款先进图像生成模型,它采用了深度压缩自编码器(DC-AE)和线性扩散变换器(DiT)等创新技术,能够在保持高质量图像生成的同时,实现极快的生成速度。这款模型支持生成高达4096×4096分辨率的图像,并且在16GB显卡上即可流畅运行,满足了广大用户对于高效图像生成的需求

ChatDLM

ChatDLM是Qafind Labs于2025年推出的新一代对话生成大模型,通过融合"区块扩散(Block Diffusion)"与"专家混合(MoE)"技术,该模型在保持7B参数量级的同时,实现了A100 GPU上2800 tokens/s的推理速度,较GPT-4等通用模型提升3-5倍。

OceanGPT沧渊

OceanGPT(沧渊)是面向海洋科学与工程任务的专业领域大语言模型。该模型立足通用人工智能,融合大语言模型、知识图谱、生成式AI、具身智能体等AI新技术,服务于AI海洋科学研究,由海洋精准感知技术全国重点实验室(浙江大学)牵头,联合浙江大学计算机学院、海洋学院及东海实验室等多学科交叉团队研制。

0

0