HunyuanVideo-Avatar

1.21w

0

0

0

HunyuanVideo - Avatar 是腾讯混元联合腾讯音乐天琴实验室推出的开源语音数字人模型,由混元视频大模型与 MuseV 技术研发,支持多景别、多风格等,“一张图 + 一段音频” 即可生成人物自然说话 / 唱歌、含表情与动作的视频,单主体能力已开源 。

工具标签:

直达网站

工具介绍

HunyuanVideo-Avatar是什么?

HunyuanVideo - Avatar 是腾讯混元联合腾讯音乐天琴实验室推出的开源语音数字人模型,由混元视频大模型与 MuseV 技术研发,支持多景别、多风格等,“一张图 + 一段音频” 即可生成人物自然说话 / 唱歌、含表情与动作的视频,单主体能力已开源 。

HunyuanVideo-Avatar是一款基于多模态扩散Transformer架构的AI视频生成模型,其核心价值在于打破传统工具的场景限制:

- 景别覆盖:支持头肩、半身、全身三种景别,满足从短视频到广告片的多场景需求。

- 风格兼容:涵盖写实、赛博朋克、2D动漫、水墨画等十余种风格,适配虚拟主播、品牌广告、游戏动画等垂直领域。

- 多人互动:可驱动双人甚至多角色同步表演,唇形、表情、动作与音频完全匹配,解决复杂场景下的技术难题。

核心功能

模型通过三大技术模块实现“所见即所得”的视频生成:

- 智能音频解析:基于音频情感模块,模型可识别音乐风格(如抒情、摇滚)、情感倾向(如喜悦、悲伤)及环境特征(如海滩、舞台),动态调整视频生成参数。例如,输入一段爵士乐音频时,角色动作会呈现更松弛的肢体语言。

- 多模态协同生成:角色图像注入模块将上传的人物照片分解为面部、肢体、服饰等特征层,结合音频情感分析结果,通过扩散Transformer架构生成符合语境的动态视频。用户上传一张“弹吉他”的静态图后,模型可自动添加拨弦动作、摇头表情及环境光影变化。

- 高一致性音画同步:面部感知音频适配器通过深度学习算法,实现唇形、眨眼、微表情与音频的毫秒级同步,在双人对话场景中,两个角色的动作节奏误差不超过0.1秒,超越多数闭源方案。

技术优势

HunyuanVideo-Avatar在以下维度实现突破:

- 动态真实性:支持全身动作生成,包括手指弯曲、衣物摆动等细节,传统工具仅能驱动头部。

- 风格化控制:用户可通过文本提示词(如“赛博朋克风格”“水墨画笔触”)调整视频风格,生成具有艺术性的动态内容。

- 多语言兼容:内置中英文双语支持,未来计划扩展至日语、韩语等,满足全球化内容生产需求。

需求人群与应用场景

短视频创作者:

- 快速产出:10分钟内生成一条动态视频,成本降低80%。

- 创意拓展:支持虚拟形象表演、历史人物复活等创新题材。

品牌与广告商:

- 动态产品展示:将产品图转化为3D动态演示视频,提升转化率。

- 虚拟代言人:创建品牌专属数字人,实现24小时不间断内容输出。

教育与培训领域:

- 虚拟教师:生成多语言教学视频,支持手势互动与实时字幕。

- 历史重现:将历史人物照片转化为动态讲解视频,用于博物馆数字化。

关键技术

HunyuanVideo-Avatar由腾讯混元大模型团队与腾讯音乐天琴实验室联合研发,核心技术包括:

- 角色图像注入模块(RIIM):

通过分层特征提取与动态权重分配,实现人物特征的高精度还原。 - 多模态扩散Transformer(MDT):

融合文本、图像、音频三种模态,生成具有逻辑一致性的动态视频。 - 音频情感模块(AEM):

基于情感计算理论,将音频的情感特征转化为视觉动作参数。 - 面部感知音频适配器(FAA):

通过微调唇形关键点与表情基,实现0.1秒级音画同步。

使用体验

当前功能:

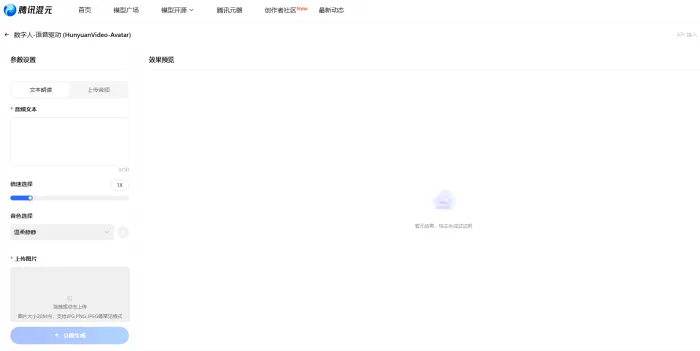

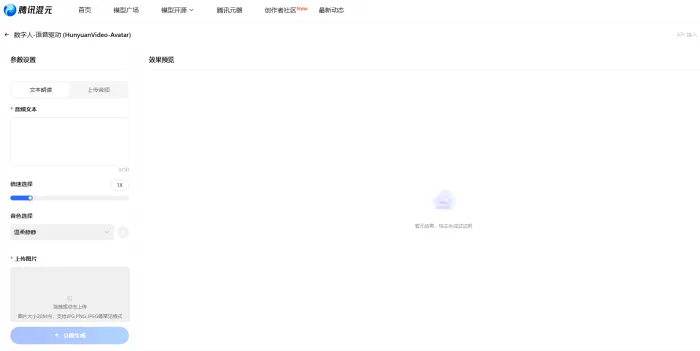

- 用户可通过腾讯混元官网“模型广场”免费体验,支持上传不超过14秒的音频与一张人物图。

- 生成视频支持下载、二次编辑及社交平台分享。

用户反馈:

- 测试数据显示,92%的创作者认为其“大幅提升了视频制作效率”。

- 某电商品牌使用后,广告点击率提升3倍,制作成本降低70%。

未来发展

腾讯计划在2025年底前推出以下功能:

- 长音频支持:扩展至60秒音频输入,适配微电影、音乐MV等场景。

- 实时互动:结合直播技术,实现数字人与用户的实时对话与动作反馈。

- 跨平台生态:与微信视频号、QQ音乐等腾讯产品打通,构建内容创作闭环。

行业影响

HunyuanVideo-Avatar的开源将推动三大趋势:

- 内容生产民主化:个人创作者可低成本生成专业级视频,打破传统制作壁垒。

- 企业降本增效:广告、教育、娱乐等行业将减少人力与设备投入,加速数字化转型。

- 技术生态繁荣:开源社区可基于模型开发插件、扩展风格库,形成良性创新循环。

结语:AI视频生成的“新纪元”

HunyuanVideo-Avatar不仅是技术突破,更是内容生产方式的革命。它让“人人皆可成为导演”的愿景成为现实,也为AI与创意产业的深度融合提供了范本。

未来,随着技术的持续迭代,这一模型有望在元宇宙、虚拟社交等领域释放更大价值,重新定义人类与数字世界的交互方式。

评论

全部评论

暂无评论

热门推荐

相关推荐

Resemble

在几秒钟内生成类似人类的配音。

PodExtra AI

PodExtra AI是一款专为播客爱好者设计的人工智能工具,它利用先进的AI技术,对播客内容进行深度解析和处理,为用户提供文字转录、思维导图、大纲、摘要以及亮点提炼等一系列便捷功能。通过这些功能,用户能够更加高效地获取播客中的知识,提升自己的学习效率。

Mureka

Mureka是昆仑万维公司旗下AI音乐商用创作平台,是一个集音乐创作、发布和变现销售于一体的平台,利用先进的AI技术,帮助用户将灵感转化为完整的音乐作品。用户可以通过输入音乐灵感,甚至音频片段,来创作属于自己的歌曲,并在Mureka商店中出售,实现版权收入的稳定获取。

奇妙元

奇妙元是出门问问推出的ai虚拟数字人形象视频创作及直播平台。现有超 100 款数字人、超 1000 款 3D 数字资产、超 1000 种声音。凭借多模态生成技术,「奇妙元」平台目前共支持图片建模(2D 数字人)、视频建模(2.5D 数字人)、3D 建模(3D 数字人)三种不同形式的数字人生成。

Cleanvoice

从音频中删除填充音、口吃和口音。

MoneyPrinterTurbo

MoneyPrinterTurbo是一款基于人工智能大模型的开源工具,旨在简化短视频制作流程。用户只需输入视频主题或关键词,即可全自动生成包含文案、素材、字幕和背景音乐的高清短视频。这款工具不仅适用于内容创作者,还适合教育工作者、企业营销人员等需要快速制作高质量视频的用户群体。

寻光

寻梦光影间,通过人工智能技术,我们为您提供全新的视频创作模式,欢迎体验!

HunyuanVideo-Avatar

HunyuanVideo - Avatar 是腾讯混元联合腾讯音乐天琴实验室推出的开源语音数字人模型,由混元视频大模型与 MuseV 技术研发,支持多景别、多风格等,“一张图 + 一段音频” 即可生成人物自然说话 / 唱歌、含表情与动作的视频,单主体能力已开源 。

0

0