F-Lite

4863

0

0

0

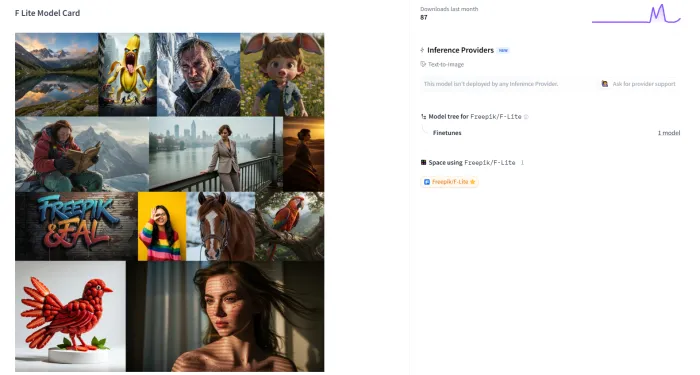

F-Lite是一款基于扩散变换器架构的文本到图像生成模型,由Black Forest Labs开发并于2025年最高1024x1024图像,并具备开源特性,适用于正式登陆Hugging Face平台。该模型以10亿参数的轻量化设计,实现了高效、低成本的图像生成能力,支持通过自然语言提示生成高分辨率

工具标签:

直达网站

工具介绍

F-Lite是什么

F-Lite是一款基于扩散变换器(Diffusion Transformer)架构的文本到图像生成模型,由Black Forest Labs开发并于2025年正式登陆Hugging Face平台。该模型以10亿参数的轻量化设计,实现了高效、低成本的图像生成能力,支持通过自然语言提示生成高分辨率(最高1024x1024)图像,并具备开源特性,适用于消费级硬件部署。

核心优势

- 轻量化设计F-Lite通过优化模型结构,将参数规模压缩至10亿,相比FLUX.1的120亿参数模型,推理效率显著提升,可在RTX3060等中端GPU上流畅运行,显存需求仅需12GB VRAM。

- 高效生成能力采用时间步精炼技术,默认采样步数减少至28步,生成单张高质量图像仅需数秒,推理速度比Stable Diffusion v1.5快约20%。

- 开源与定制化模型检查点与推理代码已通过Hugging Face公开,支持PyTorch与FLAX框架,开发者可自由定制控制模式或微调模型,推动社区创新。

- 量化优化支持int4与bfloat16量化,进一步降低显存占用,适配消费级设备,显著提升模型的可访问性。

主要功能

- 文本到图像生成用户可通过自然语言提示(如“雪山下的未来城市,赛博朋克风格”)生成高分辨率图像,支持复杂场景与风格化需求。

- 控制模式增强兼容深度控制(Depth Control)与Canny边缘控制,通过通道拼接实现类似ControlNet的效果,增强结构控制能力。

- 多模态扩展潜力支持Model Context Protocol(MCP),未来可与Qwen-Agent等框架集成,扩展多模态任务能力。

需求人群

- 开发者与研究者需要轻量化模型进行快速原型验证或学术研究的开发者,可利用F-Lite的开源特性进行二次开发。

- 中小型创作者与工作室独立艺术家、游戏开发者、影视团队等可通过F-Lite降低硬件成本,提升内容生产效率。

- 教育与科普机构教育机构可利用F-Lite生成教学插图或科学场景,增强课堂互动与研究展示。

应用场景

- 数字艺术与NFT快速生成风格化图像,适配OpenSea等平台,助力艺术家提升创作效率。

- 游戏与影视生成概念场景或角色设计,缩短前期美术周期,适合独立开发者与工作室。

- 电商与广告创建产品展示图像,提升Shopify或Instagram营销吸引力。

- 个性化创作为社交媒体生成定制化内容,如节日贺卡或表情包,满足用户分享需求。

使用教程

1.环境准备推荐硬件:CUDA兼容GPU(12GB+ VRAM)安装依赖:运行pip install diffusers==0.10.2 transformers scipy ftfy accelerate

2.模型加载代码

3.生成图像代码

4.高级定制调整参数:通过guidance_scale优化生成质量启用控制模式:结合Canny边缘控制增强结构细节

未来发展

- 技术升级Black Forest Labs计划在下一版本中增强高分辨率生成能力,优化VAE解码器以提升4K分辨率下的细节表现。

- 多模态扩展探索视频生成支持与多语言提示兼容性,推动F-Lite从静态图像生成向动态内容生成扩展。

- 生态整合可能与NVIDIA NIM Operator2.0的微服务框架整合,构建企业级生成工作流;或与Gen-4References的图像混合技术结合,实现动态内容生成。

- 社区化服务长期来看,F-Lite可能推出“生成模板市场”,提供共享提示与模型微调服务,构建类似Hugging Face的生态模式。

结语

F-Lite的推出标志着文本到图像生成技术向轻量化与普及化的迈进。其10亿参数架构与开源支持不仅挑战了SDXL与DALL-E3的高资源需求,还为中小型开发者提供了低门槛创作工具。无论是个人创作者还是企业用户,均可通过F-Lite探索AI图像生成的无限可能。

评论

全部评论

暂无评论

热门推荐

相关推荐

Magma AI

Magma是一款由微软精心打造的多模态AI模型,它旨在处理和整合图像、文本和视频等多种数据类型。与传统的AI系统不同,Magma不仅仅专注于视觉-语言理解或机器人操作等单一领域,而是将这两种能力结合成一个统一的模型,使得AI代理能够在数字和物理环境中执行更为复杂的任务。

dots.llm1

dots.llm1是小红书Hi Lab研发的1420亿参数专家混合模型(MoE),采用稀疏激活架构,推理时仅激活140亿参数。这一设计在保持高性能的同时,大幅降低了训练和推理成本。模型支持中英双语,上下文长度达32,768个token,适用于语义理解、知识问答、代码生成等多场景任务.

GPT-5

GPT-5是OpenAI最新发布的革命性大语言模型,提供GPT-5标准版、Mini版和Nano版三个版本。集成多模态能力、推理功能和验证器技术,支持免费使用,为用户提供更智能的AI对话、内容创作和编程辅助体验。

LLaMA-Factory Online

LLaMA-Factory Online是与明星开源项目LLaMA-Factory官方合作精心打造的在线大模型训练与微调服务平台。这个平台专为那些有微调需求,但工程能力不太强的用户群体量身定制,提供开箱即用、低代码、全链路功能覆盖的大模型训练与微调服务。

Hermes 4

Hermes 4是Nous Research于2025年8月发布的开源混合推理大型语言模型(LLM)系列,其核心突破在于将结构化多步推理与指令跟随能力深度融合,在数学、编程、逻辑推理等任务中达到行业领先水平,同时通过“无内容限制”设计重新定义了开源AI的边界。

Grok Code Fast1

Grok Code Fast 1是埃隆·马斯克旗下xAI公司在2025年8月29日推出的一款颠覆AI编程领域的模型。这款以“速度”为核心竞争力的模型,凭借每秒190 token的极速响应、256K超长上下文窗口以及极具侵略性的定价策略,在发布后迅速引爆开发者社区。

Mistral AI

Mistral AI成立于2023年4月,总部位于法国巴黎,作为欧洲AI领域的领军企业,Mistral致力于通过开源模型与商业化服务,打破美国科技巨头的垄断,为全球开发者提供高性能、可信赖的AI解决方案。

VACE

阿里通义Wan团队推出的视频生成和编辑模型VACE,是一款集多功能于一体的创新工具,它支持按条件生成视频、精确控制物体运动轨迹、一键替换视频主体、风格迁移、画面扩展及静态画面动态化等,极大地提升了视频创作的效率和趣味性,为视频内容创作领域带来了全新的可能性。

0

0