Runway 正式宣布 Gen-4.5 模型上线备受期待的 Image-to-Video(图生视频)功能。此次更新并非单纯的模型迭代,而是明确指向了影视级创作的核心需求:更长的故事生成能力、精准的镜头控制参数,以及在多镜头切换中保持高度连贯的叙事与角色一致性。该功能目前已向所有付费计划用户开放,标志着AI视频生成工具进一步向专业生产流迈进。

核心能力:重新定义AI视频叙事

Gen-4.5 的 Image-to-Video 功能被官方定义为 “世界上最好的视频模型”,其核心竞争力集中在解决当前 AI 视频创作的四大痛点:

更长故事 (Longer Stories)

突破短片段限制,支持生成时间更长、逻辑更完整的视频段落,为复杂叙事提供基础。

精准镜头控制 (Precise Camera Control)

创作者可精确定义推、拉、摇、移等运镜参数,告别 “抽卡式” 生成,实现导演级的画面掌控。

连贯叙事 (Coherent Narratives)

确保场景与动作在时间轴上的逻辑连贯性,减少画面崩坏或物理逻辑错误。

角色一致性 (Character Consistency)

这是本次更新的重中之重,解决了 AI 视频中人物忽大忽小、面容改变的顽疾,确保主角跨镜头身份统一。

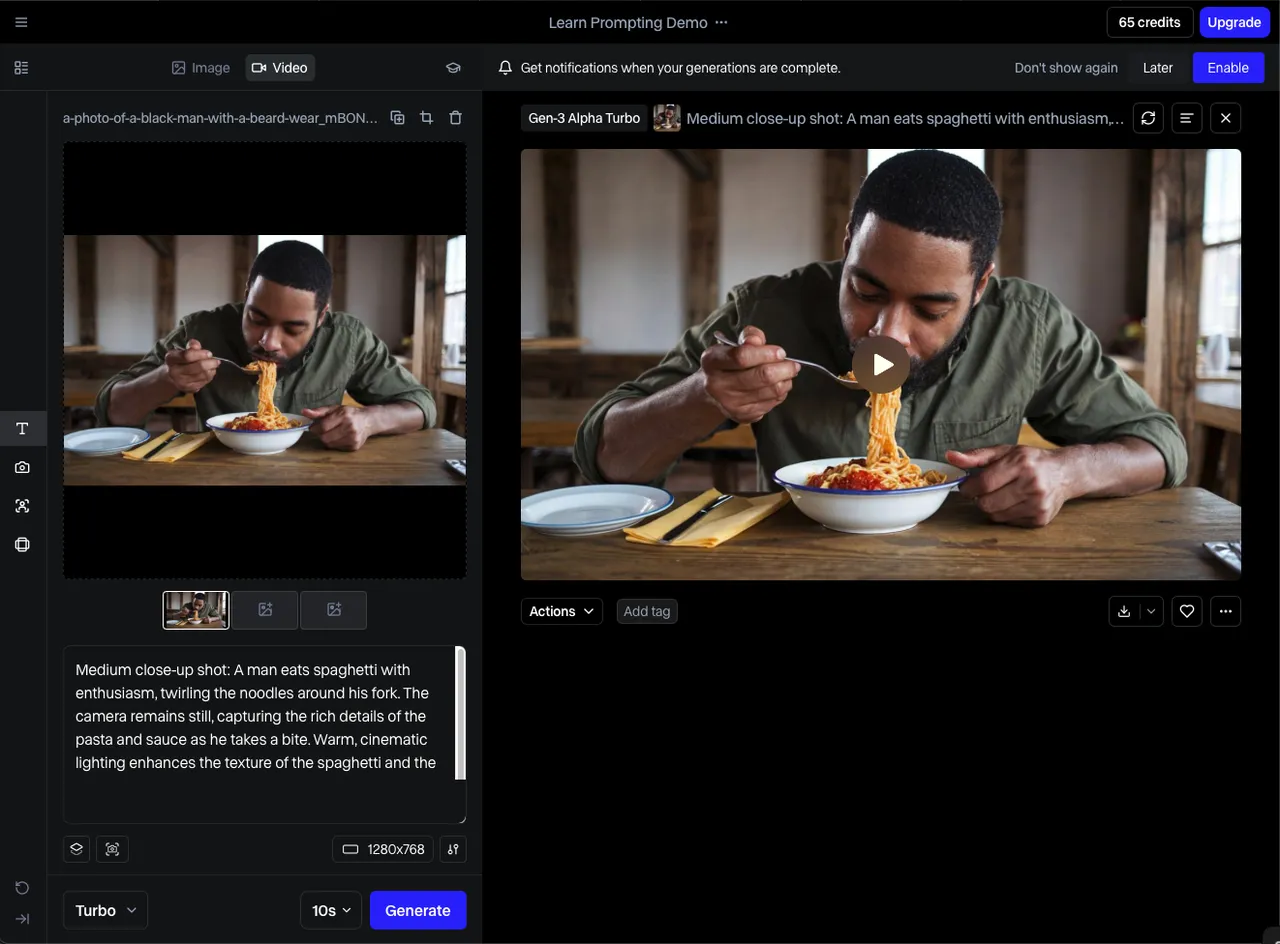

工作流与体验

此次更新直接面向付费用户开放,意味着 Image-to-Video 已具备生产级应用的稳定性。典型的工作流已十分成熟:

素材上传:用户上传基准图像(Image),作为视频生成的视觉锚点。

参数设定:在控制面板中精细调整运镜方式(Camera Motion)与运动幅度,定义镜头语言。

生成与预览:快速生成预览片段,验证动态效果是否符合预期。

迭代优化:基于初版结果微调提示词或参数,直至产出完美镜头。

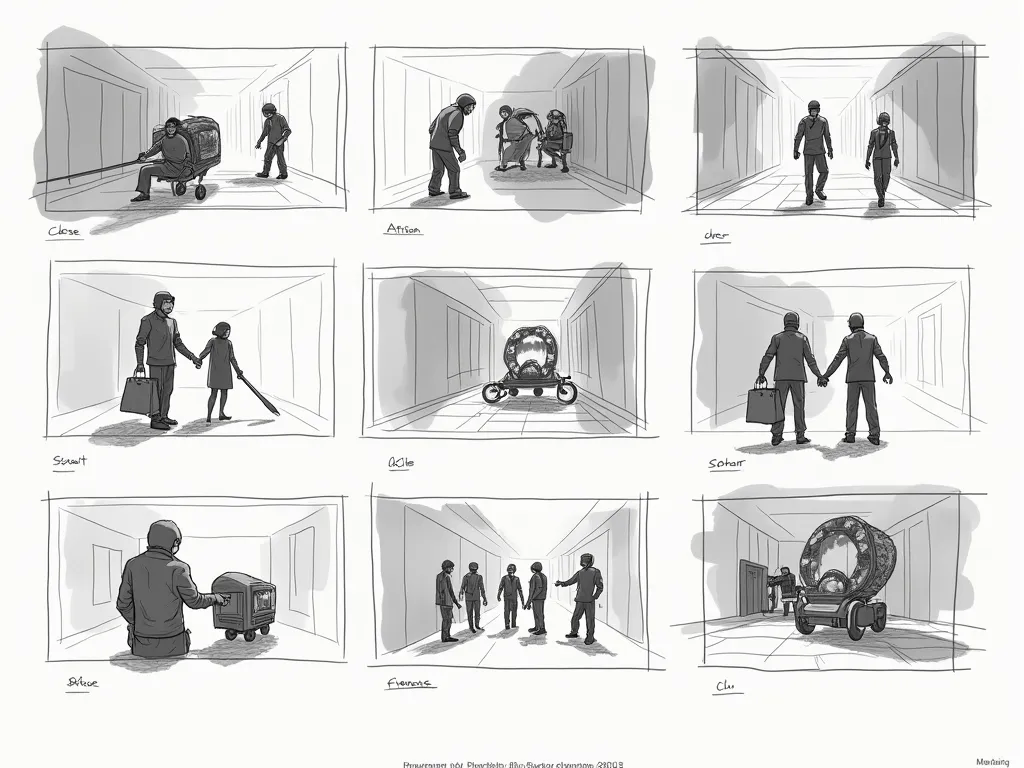

深度解析:镜头控制如何赋能叙事

在 Gen-4.5 中,镜头控制不仅仅是视角的移动,更是叙事节奏的调节器。如上图所示的故事板,从特写(Close-up)到远景(Long Shot),每一个镜头的景别选择都承载着叙事功能。

通过 Image-to-Video 的精准控制,创作者可以明确指定 “低角度仰拍” 来表现角色的压迫感,或使用 “缓慢推镜头” 来强调情绪的递进。这种对景别、机位、运动参数的精细化掌控,配合模型对角色一致性的保持,使得 AI 生成的视频不再是零散的动态图像,而是可以被剪辑、被组接的连贯故事片段,极大地提升了 “更长故事” 的视觉可信度。

AITOP100观察

Runway Gen-4.5 的 Image-to-Video 更新,精准地切中了专业视频创作者的核心痛点:长故事、精准镜头、一致角色。这标志着 AI 视频工具正加速融入主流影视制作的工作流中。对于创作者而言,现在正是尝试将 AI 辅助镜头引入实际项目的最佳时机,建议密切关注后续的参数开放与官方示例片库的更新。

Runway工具体验: https://www.aitop100.cn/tools/runway

AITOP100-AI资讯频道将持续关注AI行业新闻资讯消息,带来最新AI内容讯息。

想了解AITOP100平台其它版块的内容,请点击下方超链接查看

AI创作大赛 | AI活动 | AI工具集 | AI资讯专区 | AI小说

AITOP100平台官方交流社群二维码: